时间:北京时间 2026年4月9日

一、开篇引入

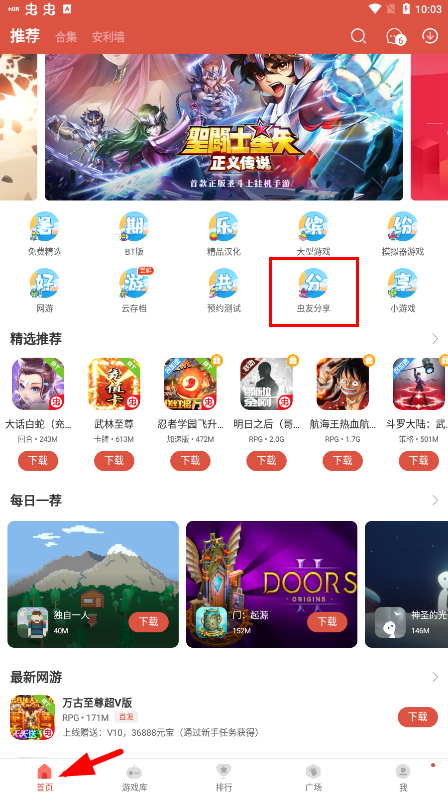

在AI能力从“对话生成”迈向“任务执行”的2026年,虫虫助手AI正成为连接用户意图与自动执行的关键桥梁-。不少学习者面临一个普遍困境:用起来很方便,但一说原理就卡壳——个性化推荐靠什么算法?AI对话背后经历了哪些环节?当面试官问“虫虫助手AI的推荐系统是如何实现的”时,许多开发者只会说“用了AI”,却答不出底层逻辑。

本文将从痛点切入,带你完整理清虫虫助手AI从感知到认知、从概念到代码的完整知识链路。无论你是技术入门者、在校学生,还是正在备战面试的开发者,都能在这里找到既易懂又实用的答案。

二、痛点切入:为什么需要虫虫助手AI

让我们先看一个传统方案的真实案例——某游戏资讯App的“攻略推荐”模块:

// 传统方案:硬编码规则匹配 public List<Article> recommendArticles(String gameId, String userId) { List<Article> result = new ArrayList<>(); // 规则1:先按游戏ID筛选 for (Article a : allArticles) { if (a.getGameId().equals(gameId)) { result.add(a); } } // 规则2:再按浏览量排序 result.sort((a, b) -> b.getViews() - a.getViews()); // 规则3:取前10条 return result.subList(0, Math.min(10, result.size())); }

这段代码暴露了三类典型痛点:

① 耦合高:推荐逻辑硬编码在业务代码中,每次调整策略都需要重新发版;

② 扩展性差:想加入“用户画像”“实时热度”等维度,代码迅速膨胀为“意大利面”;

③ 缺乏个性化:所有用户看到同样的推荐,没有“千人千面”的效果。

虫虫助手AI的设计初衷正是为了解决这些问题——通过人工智能技术,提供智能化、个性化的服务体验-。它不再是僵硬的规则匹配,而是能够理解用户意图、自主学习、动态调整的智能伙伴-6。

三、核心概念讲解:虫虫助手AI的智能推荐

3.1 定义

智能推荐(Intelligent Recommendation) ,是指基于用户行为数据和内容特征,通过机器学习算法自动筛选并推送用户可能感兴趣内容的技术手段。

3.2 关键词拆解

| 关键词 | 内涵解释 |

|---|---|

| 用户行为数据 | 点击、浏览时长、记录、点赞收藏等 |

| 内容特征 | 游戏类型、难度等级、画风、热度、发布时间 |

| 机器学习算法 | 从数据中自动学习规律,而非人工编写规则 |

3.3 生活化类比

想象一个非常懂你的游戏店长:你每次来店里,他都会默默记录你的偏好——喜欢什么类型的游戏、通常玩多久、对哪些活动感兴趣。慢慢地,他不再等你开口,就能把你可能喜欢的游戏摆在最显眼的位置。虫虫助手AI的推荐系统,本质上就是这位“懂你的店长”,只不过它服务的用户数以百万计,决策速度以毫秒计。

3.4 虫虫助手AI的价值

虫虫助手AI的推荐系统不仅基于用户偏好精准推送内容,还能动态适应兴趣变化,让玩家始终站在游戏潮流的最前沿-1-13。根据用户反馈数据,这种个性化推荐策略的准确率可达90%以上-2。

四、关联概念讲解:NLP与LLM API

4.1 自然语言处理(NLP)

自然语言处理(Natural Language Processing,NLP) 是人工智能的一个分支,赋予机器理解、解释和生成人类语言的能力-20。

4.2 大语言模型API(LLM API)

大语言模型应用程序接口(Large Language Model Application Programming Interface,LLM API) 是开发者调用大语言模型能力的标准化接口。通过API,可直接调用千亿级参数模型的推理能力,无需关心底层算力设施的部署和运维-39。

4.3 二者关系

NLP是学科领域,LLM API是落地手段。 打个比方:NLP相当于“烹饪学”,研究食物如何做得更好吃;LLM API则是“菜谱+厨具接口”,让你直接按步骤做出美味。虫虫助手AI在实现智能问答、聊天陪伴、内容创作等功能时,背后正是通过LLM API调用了大模型的能力-5-6。

4.4 对比总结

| 对比维度 | NLP(自然语言处理) | LLM API(大模型API) |

|---|---|---|

| 本质 | 学科/技术领域 | 工程实现工具 |

| 层次 | 理论层 | 应用层 |

| 关注点 | 语言理解与生成的算法原理 | 如何便捷调用模型能力 |

| 关系 | LLM API是实现NLP能力的工程手段之一 |

一句话总结:NLP是“大脑的工作原理”,LLM API是“让大脑听话的调用接口”。

五、代码示例:调用LLM API实现智能问答

下面是一个简洁的Python示例,展示如何通过LLM API实现虫虫助手AI的核心问答能力:

import requests import json 配置API(以兼容OpenAI格式的聚合API为例) API_URL = "https://api.your-gateway.com/v1/chat/completions" API_KEY = "your-api-key" def ai_chat(user_message: str, system_prompt: str = None) -> str: """虫虫助手AI智能问答核心函数""" 构建消息体(System Prompt设定AI人设) messages = [] if system_prompt: messages.append({"role": "system", "content": system_prompt}) messages.append({"role": "user", "content": user_message}) 调用LLM API response = requests.post( API_URL, headers={ "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" }, json={ "model": "gpt-4o", 模型选择 "messages": messages, "temperature": 0.7, 控制创造性(0保守~1创意) "max_tokens": 500 输出长度限制 } ) 解析返回结果 result = response.json() return result["choices"][0]["message"]["content"] 实际调用示例 if __name__ == "__main__": reply = ai_chat("帮我推荐几款适合新手的策略游戏") print(reply)

5.1 执行流程解读

| 步骤 | 发生了什么 |

|---|---|

| ① 构建消息 | 将用户输入包装为标准的message格式,System Prompt设定AI角色 |

| ② 调用API | HTTP POST请求发送至LLM API网关,包含模型参数 |

| ③ 模型推理 | 大模型在云端进行推理计算(数亿到千亿参数同时参与) |

| ④ 返回结果 | API返回模型生成的文本,解析后展示给用户 |

5.2 关键参数说明

temperature:控制输出随机性,越低越保守(适合事实问答),越高越有创意(适合头脑风暴)-39

max_tokens:限制输出长度,防止大模型“滔滔不绝”

六、底层原理支撑

虫虫助手AI的智能化能力,底层依赖三大核心技术:

6.1 机器学习(Machine Learning,ML)

虫虫助手采用先进的机器学习算法,通过持续学习和优化模型,提高数据分析的准确性和效率-16。推荐系统的精准度随使用时长增长而不断提升-2。

6.2 深度学习与Transformer架构

NLP能力的核心突破源于Transformer架构,它通过自注意力机制捕捉语言中的长距离依赖关系,极大提升了模型的上下文理解能力-20。虫虫助手的智能问答功能正是建立在此基础之上。

6.3 高性能计算与实时处理

游戏策略分析、实时推荐等场景对响应速度要求极高,高性能计算技术使得海量游戏数据的快速处理成为可能,保证虫虫助手AI能够实时捕捉并分析数据变化-16。

七、高频面试题与参考答案

Q1:虫虫助手的智能推荐系统是如何实现的?简述核心算法思路。

参考答案:

数据采集层:收集用户行为数据(点击、浏览、收藏)和游戏内容特征(类型、热度、难度);

召回层:通过协同过滤或向量检索快速筛选候选集(如基于用户相似度或内容相似度);

排序层:使用机器学习模型(如逻辑回归、GBDT)对候选集进行精排打分;

策略层:结合多样性策略和业务规则输出最终推荐结果。

踩分点:讲清“召回→排序→策略”三层架构,体现对推荐系统完整流程的理解。

Q2:什么是LLM API?虫虫助手中的AI对话功能如何通过它实现?

参考答案:

LLM API是大语言模型应用程序接口,提供标准化的HTTP接口调用方式。虫虫助手AI的实现流程为:

用户输入 → 封装为

messages格式(含system/user角色)→ POST请求发送至API网关 → 大模型云端推理 → 返回生成文本 → 展示给用户。

踩分点:说明API的标准化价值(无需自建模型)、调用流程的关键环节、System Prompt的作用。

Q3:对比传统规则推荐与虫虫助手的AI推荐,各有何优劣?

参考答案:

| 维度 | 传统规则推荐 | AI智能推荐 |

|---|---|---|

| 实现成本 | 初期低,但维护困难 | 初期高,但扩展性好 |

| 个性化程度 | 弱(千人一面) | 强(千人千面) |

| 可解释性 | 强(规则透明) | 弱(黑盒模型) |

| 冷启动处理 | 靠人工规则兜底 | 需借助流行度/探索机制 |

踩分点:对比全面、客观,能指出各自的适用场景。

Q4:System Prompt在LLM调用中起什么作用?举例说明。

参考答案:

System Prompt设定AI的“人设”、行为准则和回复风格,是Prompt Engineering的核心环节-39。例如虫虫助手AI可设置为“你是一名专业的游戏攻略专家,请用简洁清晰的语言回答玩家问题”,从而确保回答的专业性和一致性。

踩分点:准确理解System Prompt的角色设定功能,能举出具体示例。

Q5:虫虫助手AI的推荐系统如何应对“用户兴趣漂移”(兴趣随时间变化)?

参考答案:

时间衰减权重:近期行为赋予更高权重,越旧的数据衰减越快;

实时行为捕捉:实时流处理用户最新点击/行为,即时更新用户画像;

探索与利用平衡:保留一定比例的“探索性推荐”,主动探测用户潜在新兴趣。

踩分点:能点出“时间衰减”“实时更新”“探索-利用”三个核心策略。

八、结尾总结

本文围绕虫虫助手AI的技术体系,依次剖析了:

| 知识点 | 核心要点 |

|---|---|

| 问题背景 | 传统规则匹配的耦合高、扩展差、无个性化三大痛点 |

| 核心概念 | 智能推荐的“数据采集→召回→排序→策略”四层架构 |

| 关联概念 | NLP(学科)vs LLM API(落地手段)的关系辨析 |

| 代码示例 | LLM API调用的完整流程与关键参数解读 |

| 底层原理 | ML、Transformer、高性能计算三大技术支撑 |

| 面试要点 | 推荐系统流程、LLM API原理、System Prompt作用等高频考点 |

易错点提醒:不要将“调用API”等同于“理解原理”,面试中既要能写代码,更要能讲清数据流向和模型机制。

下一篇预告:我们将深入探讨虫虫助手AI的Agent架构——从“被动问答”到“主动执行”,看AI如何自主拆解任务、调用工具、完成闭环流程。