在端侧AI从“锦上添花”走向“系统刚需”的2026年,回望华为 Mate 10 搭载的AI助手技术体系,依然具有教科书级的参考价值——它是全球首款将专用神经网络计算单元(NPU)引入智能手机的里程碑产品,首次在硬件层面定义了“AI手机”的技术底座。今天我们从架构视角,讲透它的原理、代码与面试要点。

一、痛点切入:为什么手机需要独立的 AI 硬件?

在 Mate 10 之前,手机上的 AI 任务普遍依赖 CPU 和 GPU 运行。以实时图像识别为例:CPU 处理深度学习计算时,要么性能不足、耗时过长,要么能耗巨大、导致设备发烫掉电-16。传统芯片架构以 CPU/GPU/DSP 为核心,难以支持 AI 海量数据的并行计算需求-17。

早期 AI 方案过度依赖云端——数据上传云端处理,不仅消耗大量流量,还带来隐私安全风险。模型更新受限于网络条件,用户体验“时好时坏”。

这正是专用 NPU 出现的必要性:将 AI 计算能力从云端迁移到端侧,从“借来的能力”变为“内置的本能”。

二、核心概念:NPU(神经网络处理单元)

NPU,全称 Neural Network Processing Unit(神经网络处理单元) ,是专为神经网络计算设计的硬件加速单元。

生活化类比:可以把 CPU 比作“全能杂工”——什么活都能干,但干专门的活效率不高;GPU 像“美术生”——擅长图形渲染这类并行视觉任务;而 NPU 则是“数学特长生”,专门处理矩阵乘法、卷积运算等 AI 核心计算,又快又省电。

作用与价值:麒麟 970 芯片集成的 NPU,处理相同 AI 任务时,相较于四核 Cortex-A73 架构,能效提升约 50 倍,性能提升约 25 倍,图像识别速度可达约 2000 张/分钟-16-。现场演示中,搭载 NPU 的 Mate 10 仅用 5 秒完成 100 张图像识别,比竞争对手快 20 倍-17。

麒麟 970 采用台积电 10nm 工艺,在指甲大小的芯片上集成了 55 亿个晶体管,包含 8 核 CPU、12 核 GPU、双 ISP 和创新的 HiAI 移动计算架构-21。

三、关联概念:HiAI 移动计算平台

HiAI,全称 Huawei AI(华为人工智能平台) ,是华为面向移动终端的 AI 开放平台。它构建了 “芯片—设备—云”三层开放架构,让开发者能够快速调用华为终端的 AI 处理能力-。

HiAI 不是“某一个 AI 模型”,而是一整套端侧 AI 的系统能力-48。从下往上,鸿蒙 AI 栈分为四层-24:

硬件层:CPU + GPU + NPU(昇腾/麒麟 NPU),异构算力是前提

HiAI Foundation:算力抽象、模型管理、推理调度、能耗感知——HiAI 的“心脏”

HiAI Framework:开发者直接调用的能力层,包括 AI Vision、AI Speech、AI NLP、AI Learning

应用层:相机、智慧助手、输入法等终端应用

四、概念关系与区别总结

| 维度 | NPU | HiAI |

|---|---|---|

| 本质 | 硬件计算单元 | 软件能力平台 |

| 层次 | 硬件层/芯片层 | 中间件层/框架层 |

| 作用 | 提供 AI 算力 | 调度和封装 AI 能力 |

| 关系 | HiAI 的“心脏” | NPU 的“操作系统” |

一句话记忆:NPU 是“发动机”,HiAI 是“方向盘+变速箱”。NPU 负责“算得快”,HiAI 负责“用得好”——让开发者不用关心底层硬件细节,一句话调用 AI 能力。

五、代码示例:HiAI 能力调用

下面以鸿蒙应用调用 HiAI 的 AI 能力为例,展示端侧 AI 的使用方式-24:

// 加载 AI 模型——开发者不指定硬件 import { HiAIModelManager } from '@hms.ai'; const manager = HiAIModelManager.getInstance(); const model = await manager.loadModel('face_detect'); // 执行推理——系统底层自动调度 const inputData = new Float32Array([/ 图像数据 /]); const result = await model.run(inputData);

关键点:代码中没有指定 NPU/GPU/CPU。HiAI 在底层自动判断-24:

当前设备是否有 NPU?

当前负载是否适合上 NPU?

是否需要降级到 GPU?

当前电量是否允许高算力?

这就是 异构感知调度——HiAI 和很多 AI SDK 的本质区别。传统做法是开发者指定硬件,HiAI 的思路是“我来决定用谁,开发者别操心”。

六、底层原理与技术支撑

NPU 之所以能大幅提升 AI 效率,底层依赖以下几个关键点:

异构计算架构:麒麟 970 采用创新的 HiAI 移动计算架构,NPU 专门负责神经网络计算,CPU/GPU 各自专注本职工作,形成分工协同-16。

本地持续学习:Mate 10 的 AI 芯片只需从云端获取一套“学习模型”,通过优化压缩后保存在本地。这套模型会持续不断地“学习”和“训练”,逐渐适应手机使用者的习惯——你和 Mate 10 之间会“越来越有默契”-53。

算子支持:HiAI Foundation 提供了 300+ 算子的支持,具备业界最佳的模型兼容性,为众多业务场景提供更高性能、更低功耗的计算环境-。

七、高频面试题与参考答案

Q1:请解释 NPU 与 CPU/GPU 的区别。

标准答案(踩分点:定义→分工→效率对比):

定义:NPU 是专用神经网络处理单元,专为 AI 计算设计;CPU 擅长逻辑控制与串行任务;GPU 擅长图形渲染与并行浮点运算。

分工:NPU 专门负责矩阵乘法、卷积等深度学习核心运算,为 CPU/GPU 减负-17。

效率:处理相同 AI 任务,NPU 相比四核 CPU 架构,能效提升约 50 倍,性能提升约 25 倍-16。

Q2:Mate 10 的 AI 能力是如何实现的?

标准答案(踩分点:硬件→软件→应用):

硬件层:麒麟 970 首次集成 NPU 专用硬件单元,AI 运算能力大幅提升。

软件层:HiAI 移动计算平台提供异构感知调度,统一封装 AI 能力。

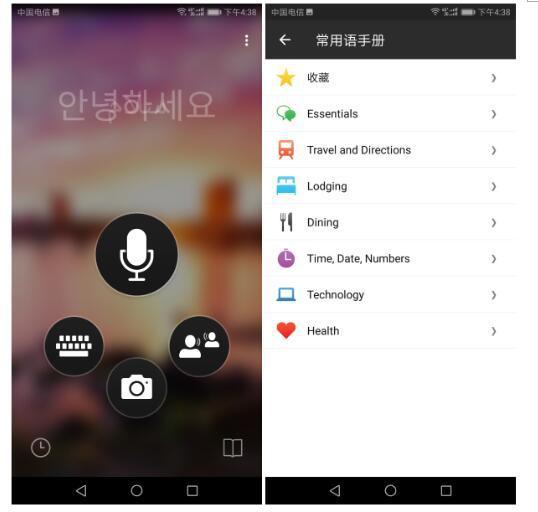

应用层:实现智慧语音、AI 拍照、实时翻译、智能识屏等场景化功能。

核心价值:端侧处理,无需依赖云端,保护隐私的同时保证实时响应-53。

Q3:HiAI 与传统 AI SDK 有什么不同?

标准答案(踩分点:调度方式→能力抽象→系统整合):

调度方式:传统 SDK 由开发者指定硬件,HiAI 由系统根据负载、功耗自动选择最优硬件。

能力抽象:传统 SDK 暴露模型名称,HiAI 暴露“文字识别”“语音识别”等系统级能力-48。

系统整合:HiAI 不是“外挂”,而是鸿蒙操作系统的内置能力层。

Q4:什么是异构感知调度?为什么重要?

标准答案:

定义:系统根据当前设备的算力负载、温度状态、电量水平、NPU 可用性等指标,自动选择最合适的硬件执行单元完成 AI 任务-24。

重要性:在不增加开发者负担的前提下,实现性能与功耗的最佳平衡,是端侧 AI 落地的关键技术。

八、结尾总结

本文围绕华为 Mate 10 的 AI 助手 技术体系,梳理了以下核心知识点:

| 模块 | 要点 |

|---|---|

| 硬件 | NPU 专用单元,50 倍能效提升,2000 张/分钟图像识别 |

| 平台 | HiAI “芯片—设备—云”三层架构,300+ 算子支持 |

| 关系 | NPU = 发动机,HiAI = 方向盘+变速箱 |

| 应用 | 智慧语音、AI 拍照、实时翻译、智能识屏等 |

| 面试 | 掌握 NPU/CPU/GPU 区别、HiAI 调度机制、端侧 AI 价值 |

进阶预告:本文聚焦 Mate 10 时代的端侧 AI 基础架构。后续将继续深入 HiAI 引擎的详细调用流程、鸿蒙 AI Agent 架构设计,以及端侧大模型的部署实战。欢迎持续关注本系列。

📌 本文数据来源于华为官方发布及第三方评测,供学习参考。技术迭代迅速,建议结合官方最新文档使用。